AI修复老片又快又好 但还取代不了专业修复师

毕竟,影视片是一种艺术表达手段。

毕竟,影视片是一种艺术表达手段。

作者| Decode

邮箱|oudibj@outlook.com

AI 修复一百年前摄于北京的视频,想必大家都看过了,但你知道 AI 具体是怎么做的吗?

(还没看过的可以点上面视频)

据南方都市报报道,作者 @大谷 Spitzer 修复这个视频的过程,主要有三部分,分别是补帧、上色和分辨率扩增。

翻译成白话,这三部分对应的是:让视频变得更流畅,比如把 24 帧变成 60 帧;让黑白视频变彩色;让视频变得更清晰,比如把 480P 变成 4K 分辨率。

具体到工具,@大谷 Spitzer 补帧用的是 DAIN,上色用的是 DeOldify,分辨率扩增用的是 ESRGAN。

AI 是怎么修复老片的?

先来看补帧的 DAIN。这是一个基于视频深度信息感知的时间帧插值算法,由上海交通大学,加利福尼亚大学和 Google 多方联合研发。

为了方便更多用户使用,研发者还提供了一个免费的 Windows 软件“DAIN-App”。

在视频领域,补帧其实不是件多新鲜的事。比如索尼电视的 Motionflow 技术和 AMD 显卡的 Fluid Motion 都是常见的补帧方案。 它们的具体实现有不同,但原理大同小异,都是用计算机模拟相邻两帧间缺失的画面,让画面变得更加流畅。

它们的具体实现有不同,但原理大同小异,都是用计算机模拟相邻两帧间缺失的画面,让画面变得更加流畅。

这些补帧方法都有一定局限性,如果画面里有大面积运动的物体,或者存在遮挡情况,补出来的影像就不是那么完美了。而 DAIN 所采用的方法,能很好解决这一问题。

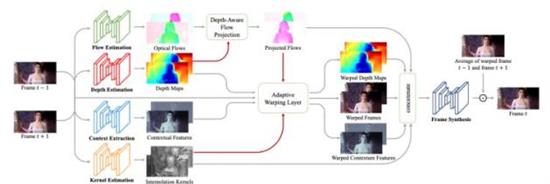

DAIN 算法不会直接生成画面,而是先通过获取视频深度信息,检测出物体遮挡情况。然后,从相邻像素收集上下文信息,来完成层次特征学习。最后,基于上述信息生成视频帧。 (DAIN 的工作流程)

(DAIN 的工作流程)

简言之,DAIN 在模拟生成一帧画面之前,额外做了很多工作。它让计算机知道了一个平面视频里,不同物体之间的远近关系和遮挡情况。并且,用了一种更有效率的方式,来对像素点进行采样,以生成更高质量的画面。

这样做的结果是,DAIN 生成的补帧画面,比起传统补帧方法,更像真实拍摄的。

在 @大谷 Spitzer 修复的视频里,如果仔细对比原片和 AI 修复片段,很容易可以感受到 DAIN 补帧的效果。比如下面这个场景里的人物动作,原片能感受到卡顿,而 AI 修复后流畅很多。

(建议在原视频 15 秒左右找到对应片段观看)

(建议在原视频 15 秒左右找到对应片段观看)

视频上色方面,@大谷 Spitzer 用到了 DeOldify,这是一个在深度学习圈非常热门的项目。

DeOldify 基于一种名为 GAN(生成对抗网络)的技术。GAN 被 AI 界的领袖 Yann LeCun 称为 “过去 10 年机器学习中最有趣的想法”,它通过两个神经网络相互博弈的方式来学习数据,能生成逼真的新内容,其中一个广为人知的应用,是可以换脸的 Deepfake。 (有人曾用 Deepfake 换脸生成了杨幂版的《射鵰英雄传》)

(有人曾用 Deepfake 换脸生成了杨幂版的《射鵰英雄传》)

DeOldify 采用了一种改良过的 GAN 模型,即保留了 GAN 训练的优点(绚烂的色彩),又消除了视频中物体闪烁等副作用。

不过,DeOldify 所呈现的色彩还原结果,并不一定是真实的情况。

“历史上这个人穿的是不是这个颜色,我觉得不然。”@大谷 Spitzer 接受中新视频采访时说,“它(AI)只是一个凭自己的训练,感觉这个人可能是这个颜色,那个人穿衣服有可能是那个颜色,它没法做到完全历史精确。”

正因如此,@大谷 Spitzer 也在视频里标注了:色彩为 AI 自我学习结果,不代表历史原色。 分辨率扩增上,@大谷 Spitzer 用的是 ESRGAN,同样是 GAN 的应用。

分辨率扩增上,@大谷 Spitzer 用的是 ESRGAN,同样是 GAN 的应用。

把一张图片放大超过其原本分辨率,是很多人经常会做的事。这样的结果是,图片会变得模糊,因此就有人去研究,怎么把图片发大超过分辨率,而不变得模糊。

ESRGAN 利用深度学习方法来解决这一问题,相比传统方法,能得到更好的效果。 AI 加速老片修复

AI 加速老片修复

用 AI 修复一段百年前北京的影片,固然非常有意义,但这项技术的应用,远不止于在社交网络刷刷屏。

不管是在线视频网站还是大荧幕,老片修复都是正在兴起的风潮,而 AI 在背后扮演着加速器的角色。

据《中国经济周刊》报道,优酷平台大数据发现,有很多用户来视频平台是来看老片子的,像《还珠格格》这样的剧,能够一直保持在流量高位上。

爱奇艺也通过大数据分析发现,经典老片具有非常广泛的用户基础,受众规模很大。在数据支持下,优酷和爱奇艺都发起了各自的老片修复计划。

而修复大荧幕电影,重新在影院上映,这事一直在进行着,远到 2009 年王家卫导演的《东邪西毒》修复上映,近到 4K 修复版的《三毛流浪记》和《海上钢琴师》。 (《三毛流浪记》修复版)

(《三毛流浪记》修复版)

事实上,自 2006 年起,中国就启动了“电影档案影片数字化修复工程”。中国电影资料馆主要负责这项工作,计划把中国 4 万部老电影胶片做数字化修复、存档。

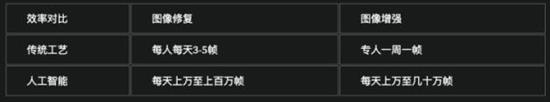

过去,老电影修复主要依靠人工,耗时耗力。据新京报报道,一天一个修复师一般只能完成 100 到 200 帧的画面修复,一部保存完好的电影,简单修复就需要两个星期。

若是要达到美学标准,一帧帧地精心还原,需要几个月甚至一两年时间,若是遇到损伤非常严重的老电影,例如创作于 1930 年代的《渔光曲》,要近两年时间才能完成。

越来越多团队开始借助 AI 这块它山之石。爱奇艺自主研发了 ZoomAI 视频增强技术,优酷也用阿里云的“画质重生”技术来修复老片。

在接受中国经济周刊采访时,爱奇艺副总裁谢丹铭说:“一部两个小时的影片,(ZoomAI)只需要 12 小时即可完成修复增强并上线,这在之前是 10 人团队近 20 天时间才能完成的工作量。与人工相比,ZoomAI 视频处理效率可提高 500 倍。”上文提到的《三毛流浪记》,正是由爱奇艺投资和参与修复的。

中影数字制作基地和中国科技大学,也共同研发了一个基于 AI 的图像处理系统“中影·神思”。

这个系统采用了 GAN、DenseNet、CycleGAN 网络等技术,由三部分组成,分别是分辨率提升画质增强处理单元、标清图像去场处理单元和图像数字修复处理单元。

借助“中影·神思”系统,中影基地已经成功修复了《厉害了,我的国》、《马路天使》、《血色浪漫》和《亮剑》等多部影视剧。

以《厉害了,我的国》这部电影为例,由六集纪录片《辉煌中国》改编而成,几乎没有新的实拍素材。原片按电视的 720X576 分辩率拍摄,修复时要扩大到 2K 分辨率。片子一拉大,“场纹、马赛克、锯齿等问题就全出来了”。

若采用纯人工方式去修复,每人每天平均只能制作 3–5 帧镜头。但借助“中影·神思”系统,修复团队得以在四个月内修复增强了 30 万帧图像。 参与到《厉害了,我的国》修复项目的肖搏,在接受媒体《画外 hoWide》采访时说,利用这个系统,修复一部电影的时间可以缩短四分之三,成本可以减少一半。他是中影基地的数字修复中心主任,迄今做了 13 年电影修复工作。

参与到《厉害了,我的国》修复项目的肖搏,在接受媒体《画外 hoWide》采访时说,利用这个系统,修复一部电影的时间可以缩短四分之三,成本可以减少一半。他是中影基地的数字修复中心主任,迄今做了 13 年电影修复工作。

更关键的是,很多以前无法修复的电影现在可以修了。肖搏举了一个例子:1949 年王滨导演的《桥》,画面重影很严重,胶片扫出来以后每个人物每一帧都有一个虚边。非常难处理,“当时我们放弃了,但现在用人工智能技术就可以解决”。

老片修复不仅是技术,更是艺术

AI 加速了老片修复的速度,但也有一定局限性。比如上文提到的,@大谷 Spitzer 用 AI 修复一百年前的老片时,对色彩还原并不准确。

“如果是由人类艺术家来做的话,他肯定是了解中国古代历史,做得应该就会更准确。”@大谷 Spitzer 说。

在专业的电影老片修复过程中,对色彩把握更是一门艺术。肖搏接受媒体采访时说,他曾修复新中国第一部彩色片《梁祝》,“桑弧导演去世了,当时的摄影师也故去了。色调的浓稠就很难界定,我们调色调了 7、8 版,需要多方专家一起来定夺”。

对老片的修复,有时候还讲究“修旧如旧”,而不是单纯地把色彩修得好看。诸如此方面的把握,AI 还很难做到令人满意。

据光明日报报道,中国电影资料馆对于老电影修复,有两组人员,一组是艺术专家组,另一组是技术专家组,两组人员缺一不可。

毫无疑问,AI 加速了老电影修复,但暂时还取代不了专业的电影修复师。毕竟,影视片是一种艺术表达手段。

阅读原文

原标题:《AI修复老片又快又好,但还取代不了专业修复师》

阅读原文

新闻推荐

由张爵西导演,狄龙、宣萱、陈沁霖、陈智深领衔主演的院线电影《我来自纽约》5月9日正式在移动电影院上线。电影上线前,在移...