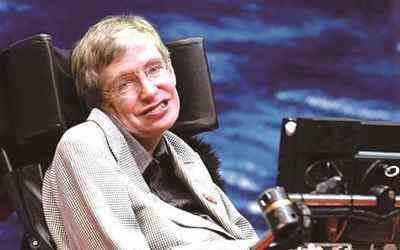

霍金在遗作中大胆预言: 这一操作或将毁灭人类!

已故物理学家斯蒂芬·霍金的最后著作《重大问题简答》10月16日出版,英国《星期日泰晤士报》提前透露了该作品中霍金对人类的担忧。

1.人工智能

霍金对规范管理人工智能的重要性提出了严重警告,指出“未来人工智能可能形成自己的意志,与我们人类相冲突的意志”。他在书中写道,应当制止可能出现的自动武器军备竞赛,提出“如果发生类似于2010年股市闪电崩盘那样的武器崩盘,其后果将会如何”的疑问。

他接着写道:“对人类来说,超级智慧的人工智能的出现不是福就是祸,二者必居其一。人工智能的真正危险并非在于恶意,而在于能力。超级智慧的人工智能将极其擅长实现目标。如果这些目标与我们不一致,那我们就麻烦了。你可能不是出于恶意而踩死蚂蚁的那种人,但是如果你负责一项水力环保能源项目,而洪水淹没地区有一个蚁丘,那么蚂蚁就惨了。我们别让人类陷入蚂蚁的境况。”

2.基因编辑和超人

霍金在书中预言道:“未来1000年的某个时刻,核战争或环境灾难将严重破坏地球”。可是,到那时,“我们的天才种族将已经发现了摆脱地球粗暴束缚的办法,因此能够战胜灾难”。

霍金表示,成功逃离地球的人很可能是新的“超人”,他们利用诸如“规律成簇间隔短回文重复系统(CRISPR)”这样的基因编辑技术超过其他人。

英国《每日镜报》网站也披露,斯蒂芬·霍金的最后担忧是:操纵DNA将催生超人优等民族,最终毁灭人类。

3.太空智慧生命

有关为何尚未发现智慧生命或是智慧生命没有造访地球这类问题,霍金承认有各种各样的说法。对此,他的预言并不那么大胆,但他首选的解释是:人类“忽视了”外太空智慧生命的形式。

据中新社

新闻推荐

截至10月16日,据同花顺统计数据显示,按照申银万国行业分类,沪深两市共计52家上市房企披露了2018年三季度业绩预告,剔除数据不...